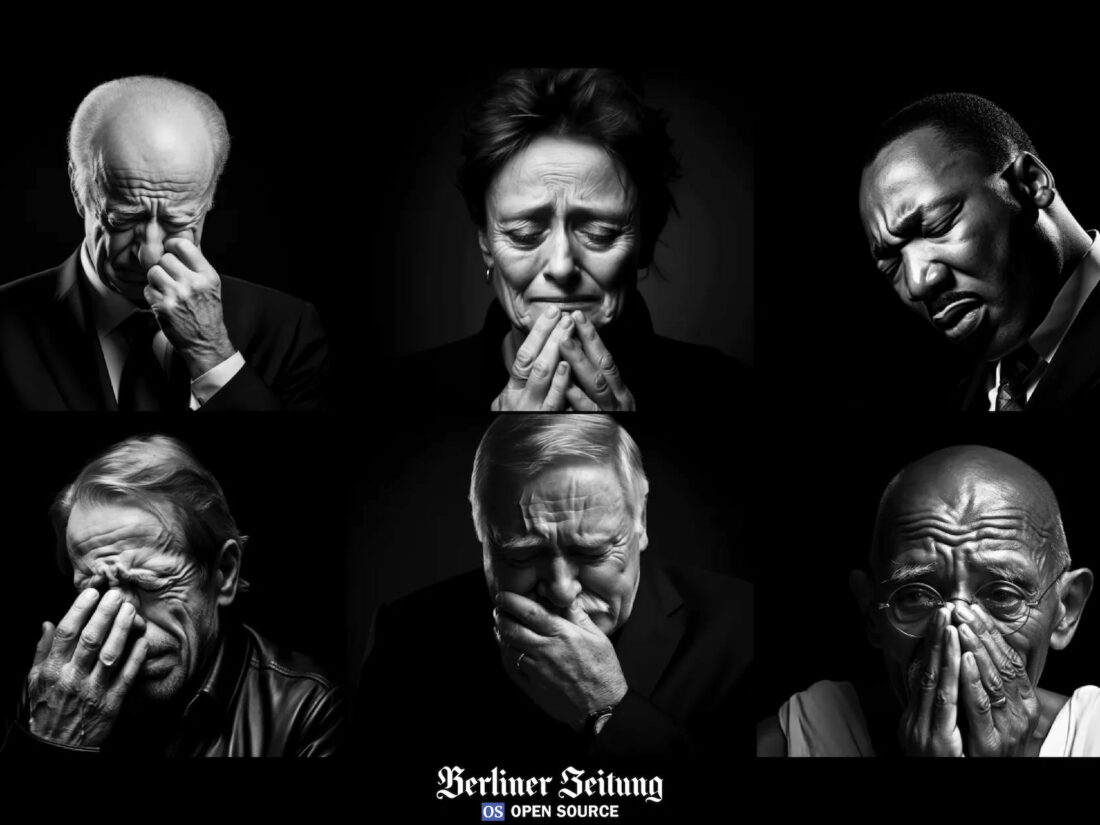

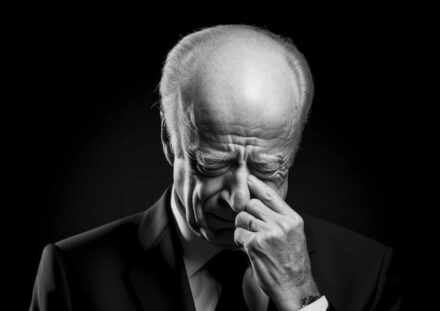

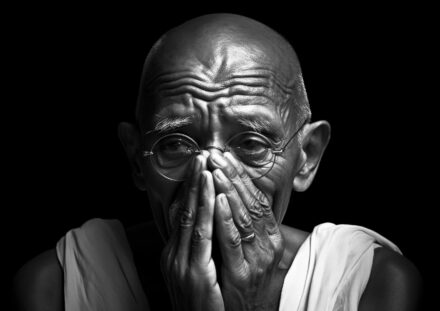

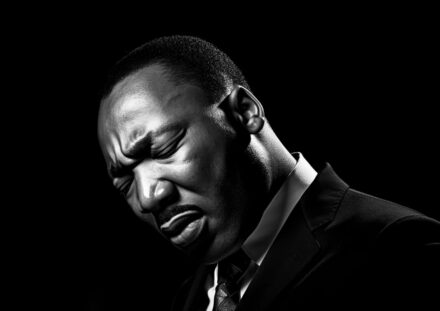

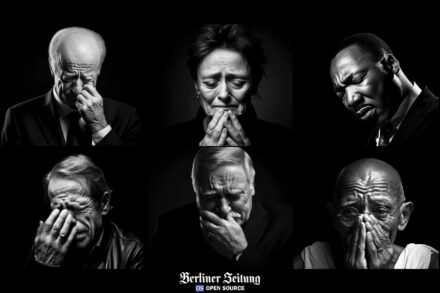

Die Berliner Zeitung hat unter der Bezeichnung „Open Source“ eine digitale Plattform online gestellt, auf der freie Autoren Beiträge veröffentlichen können. Beworben wird die Plattform mit Motiven, die von KI-Bildgeneratoren erstellt wurden und prominente Personen darstellen. Auf den Motiven sind (mutmaßlich) Mahatma Gandhi, Václav Havel, Bärbel Bohley und Martin Luther King und andere Persönlichkeiten mit stark emotionalisierter Mimik/Gestik zu sehen. Eine in vielerlei Hinsicht bedenkliche, da grenzüberschreitende Kampagne. Ein Kommentar.

Seit einigen Tagen ist unter der URL berliner-zeitung.de/open-source/ eine digitale Plattform der Berliner Zeitung online. Sinn und Zweck der Plattform wird von der Berliner Zeitung wie folgt beschrieben:

Mit Open Source gibt der Berliner Verlag freien Autorinnen und Autoren sowie jedem Interessierten die Möglichkeit, Texte mit inhaltlicher Relevanz und professionellen Qualitätsstandards anzubieten. Ausgewählte Beiträge werden veröffentlicht und honoriert.

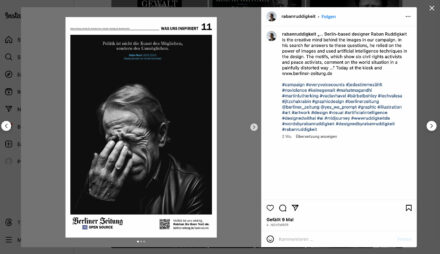

Beworben wird die Plattform mit von KI-Bildgeneratoren erstellten Motiven, die prominente Personen darstellen. Die Macher erläutern die Kampagnenidee wie folgt:

Wir haben uns gefragt: Was ist aus dem Geist der friedlichen Revolution geworden, der zum Mauerfall vom 9. November 1989 führte, der die Proteste und Veränderungen zuvor in Ost-Berlin, Prag, Warschau und anderswo trug? Wie würden Bürgerrechtler und Friedensaktivisten, die sich für Gewaltfreiheit, Debatte und Dialog einsetzten – wie die Bürgerrechtlerin und Gründerin des „Neuen Forum“, Bärbel Bohley – auf das Heute blicken, auf die aktuelle Weltlage? Auf Russlands Krieg in der Ukraine, auf die Gewalteskalation im Nahen Osten?

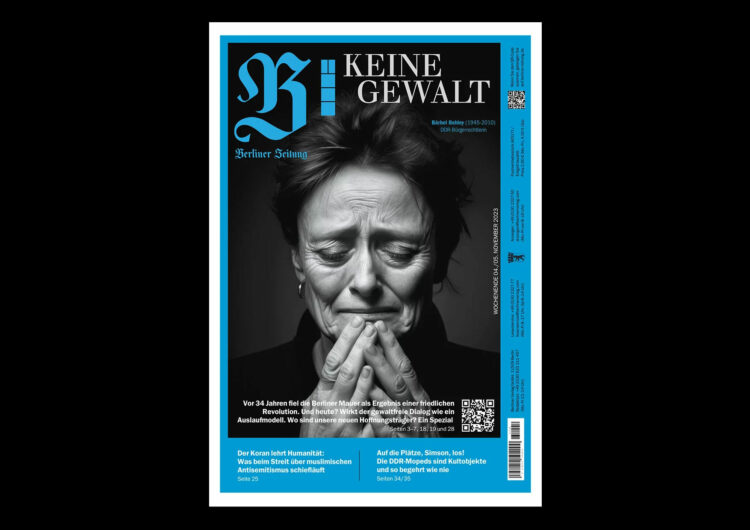

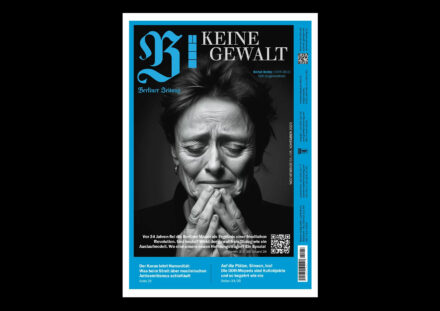

Die Wochenendausgabe der Berliner Zeitung vom 4. und 5. November 2023 ziert eines der Motive. Abgebildet ist eine Darstellung von Bärbel Bohley. Die Abbildung ist mit der Bildunterschrift „Bärbel Bohley (1945-2010) DDR-Bürgerrechtlerin“ versehen. Dass es sich bei dem Motiv um eine mit Hilfe von Künstlicher Intelligenz erzeugten nicht-realen Darstellung von Bärbel Bohley handelt, ist auf dem Cover nicht ersichtlich.

Die Kampagne wirft viele gesellschaftlich hochrelevante Fragen auf. Etwa, ob die Persönlichkeitsrechte der gezeigten Menschen verletzt wird. Inwieweit Deepfakes als Stilmittel der Freiheit der Kunst bzw. der freien Meinungsäußerung angesehen werden können. Denn nichts anderes stellen die Motive der Kampagne dar: Deepfakes.

Es findet, nach meinem Ermessen, eine Vereinnahmung der abgebildeten Personen zu kommerziellen Zwecken statt. Möglicherweise tangiert die Kampagne auch das Thema Urheberrecht. Dies wäre der Fall, wenn das gezeigte Bildsujet die Handschrift eines Fotografen trüge, wenn es besondere stilistische Merkmale aufwiese, die sich einem bestimmten Urheber zuschreiben ließen. Um den Rahmen nicht zu sprengen, verzichte an dieser Stelle auf eine nähere Untersuchung. Wer die Motive in dieser Hinsicht genauer unter die Lupe nehmen mag – in den Kommentaren ist reichlich Platz. Ich würde mich sehr freuen. Ich möchte jedoch weiter auf den Aspekt der Werbung mit bekannten Personen eingehen.

Der Deutsche Werberat, eine seit 1972 bestehende Selbstkontrolleinrichtung der Werbewirtschaft, definiert in dem von ihm verfassten Werbekodex die Richtlinie für Werbung mit Prominenten wie folgt:

In der Werbung dürfen Bilder und /oder Namen von Menschen oder sonstige dem Persönlichkeitsbereich zuzurechnende Darstellungen nur mit deren Zustimmung verwandt werden. Eine Ausnahme von diesem Erfordernis kommt nur dann in Betracht, wenn es sich – wie bei Bundespolitikern – um so genannte Personen der Zeitgeschichte handelt und erkennbar der Informations- und Dokumentationszweck, nicht aber das Geschäftsinteresse, im Vordergrund steht.

Zweifelsfrei handelt es sich bei den in der BZ-Kampagne dargestellten Personen um Personen von zeitgeschichtlicher Bedeutung. Da bis auf Lech Wałęsa bereits alle Personen tot sind, stellt sich die Frage nach der Zustimmung zur Verwendung nicht. Es ist davon auszugehen, dass es keine gibt. Eindeutig ist, dass die Kampagne einem Geschäftsinteresse dient.

Dass prominente Menschen mitunter hinnehmen müssen, im Rahmen von Werbung vereinnahmt zu werden, durfte beispielsweise Claus Weselsky erfahren. Der Chef der Lokführergewerkschaft (GDL) muss eine Werbung des Autovermieters Sixt mit seinem Foto und der Bezeichnung „Mitarbeiter des Monats“ hinnehmen, so jedenfalls entschied es das Landgericht Leipzig in einem Urteil 2018. Als zentrales Argument führte das Gericht an, Adressaten würden den satirischen Charakter der Werbung erkennen.

Einen satirischen Charakter weist die BZ-Kampagne nicht auf. Auch ist für Leser nicht zu erkennen, dass die Motive nicht etwa reale Personen abbilden. Denn eine entsprechende Kennzeichnung fehlt. Dargestellt sind nicht etwa Jitzchak Rabin, Bärbel Bohley, Martin Luther King, Václav Havel, Lech Wałęsa und Mahatma Gandhi, sondern lediglich Nachbildungen dieser Personen, künstlich erzeugte digitale Repliken. Diese Information bleibt die Berliner Zeitung dem Betrachter schuldig.

Die Differenzierung zwischen Mensch und Replik ist im Hinblick auf die Rezeption von KI-generierten Inhalten immanent. René Magritte wies in seinem berühmten Werk „Der Verrat der Bilder“ darauf hin, dass das Dargestellte nicht der Realität entspricht („Ceci n’est pas une pipe“, zu deutsch: „Dies ist keine Pfeife“). Auf dem oben gezeigten BZ-Cover ist NICHT die DDR-Bürgerrechtlerin und Malerin Bärbel Bohley abgebildet. Es zeigt eine Replik. Die Bildunterschrift ist falsch.

Heutzutage ist es selbst für Experten und Faktenchecker mitunter eine Herausforderung, zu benennen, was echt und was Fake ist. Bilder und Grafiken, Musikstücke, Stimmen, Darsteller, Texte und andere mit Hilfe von KI-Engines angefertigten Erzeugnisse, die von Menschen geschaffene Werke nachbilden, sollten so aufbereitet werden, dass Leser, Zuschauer, Konsumenten und Anwender erkennen können, dass es sich um Maschinen-gemachte Objekte und Produkte handelt. Eine Kennzeichnung ist überdies schon allein der journalistischen Sorgfaltspflicht wegen geboten, denn es handelt sich im konkreten Fall um eine Form der Bildmanipulation.

Unter dem Motto „KI aber fair“ haben Design- und Kreativverbände, Organisationen, Medien und Privatpersonen im Frühjahr 2023 eine Vorgabe hinsichtlich der Kennzeichnungspflicht für KI-generierte Medien formuliert (mit Fokus auf Urheberrechte). Das dt gehört zu den Erstunterzeichnern. Aus dem Positionspapier zitierend:

Wir fordern eine Kennzeichnungspflicht für KI-generierte Erzeugnisse. Für Nutzende muss schnell und eindeutig ersichtlich sein, ob ein Text, ein Bild, Musikstück oder Video von Menschen erstellt und geprüft oder durch KI generiert wurde. Ein Höchstmaß an Transparenz bei allen Aspekten der Entwicklung, Produktion und Bereitstellung ist sowohl für die Nutzenden erforderlich als auch für die Kreativschaffenden, damit sie ggf. ihr Recht am eigenen Werk wahrnehmen können

Im Rahmen seiner Stellungnahme „Mensch und Maschine“ (PDF) hat auch der Deutsche Ethikrat im Februar 2023 die Bedeutung von Transparenz im Zusammenhang mit Künstlicher Intelligenz betont. Menschliche Autorschaft gelte es zu stärken, den Einsatz von KI-Systemen „hinreichend transparent und nachvollziehbar“ zu machen. Dieser Empfehlung (mit Fokus auf Urheberrechte) hat sich auch der Deutsche Kulturrat im Juni 2023 angeschlossen. Und dieser Transparenzpflicht kommt die Berliner Zeitung in ihrer Kampagne nicht in erforderlichem Umfang nach.

Nach wie vor wird der Einsatz Künstlicher Intelligenz kaum reguliert. Der Verordnungsvorschlag der EU-Kommission zur Festlegung harmonisierter Vorschriften für Künstliche Intelligenz (Gesetz über Künstliche Intelligenz, AI-Act) wurde zwar im Juni 2023 vorgelegt, aktuell hat der Vorschriftenentwurf jedoch keine gesetzgeberische Funktion. Mit der Ratifizierung des Entwurfs – diese scheint in weite Ferne gerückt, da sich Deutschland, Frankreich und Italien querstellen – ist die Debatte gleichwohl nicht beendet. Vermutlich wird sie niemals enden, was gut wäre. Für und Wider gilt es heute wie morgen abzuwägen, und immer wieder neu zu verhandeln, denn die Technologie entwickelt sich rasend schnell weiter. Es gibt viel zu diskutieren, zu hinterfragen, anzupassen, neu zu strukturieren, zu überarbeiten, aufzubereiten und zu regeln.

So müssen auch die vom Werberat formulierten „Grundregeln zur kommerziellen Kommunikation“, im Jahr 2007 verfasst, als stark reformbedürftig bezeichnet werden. Denn der sogenannte Werbekodex enthält keinerlei Aussagen zum Themenkomplex Künstliche Intelligenz. Nicht nur Betriebe der Kreativwirtschaft sind gut damit beraten, den Umgang mit KI-Technologie für sich zu definieren und zu regeln, seien es Verlags- und Medienhäuser, Agenturen, Unternehmen mit Grafikabteilungen, Spieleentwickler, Fotostudios, Kommunikations- und PR-Abteilungen oder Musik- und Tonstudios. Da Künstliche Intelligenz nahezu in allen Bereichen des öffentlichen und privaten Lebens Einzug gehalten hat, müssen sich im Grunde alle Unternehmen, Gewerbetreibende, alle Marktteilnehmer, alle Künstler und Kreativschaffende zum Thema KI positionieren, besser heute als morgen.

So wie es kürzlich US-amerikanische Schauspieler getan haben. Mit ihrem von der Gewerkschaft „Screen Actors Guild (SAG)“ organisierten viermonatigen Streik haben sie erreicht, dass der Einsatz von KI-Technologie in ihrer Arbeitswelt geregelt und begrenzt wird. Zukünftig erfolgt, so die Einigung, „für die Erstellung und Nutzung digitaler Repliken lebender und verstorbener SAG-Mitglieder, unabhängig davon, ob diese am Set erstellt oder für die Nutzung lizenziert wurden, eine Vergütung“. Die Nutzung digitaler Repliken setzt also die Zustimmung der jeweiligen Schauspieler voraus (bzw. deren Nachkommen, Nachlassverwalter, Rechteinhaber, u.a.). Vorbildcharakter auch für andere Branchen, in anderen Ländern? Unbedingt.

In der sogenannten „Hambacher Erklärung zur Künstlichen“ (PDF), bereits im April 2019 verfasst, wurde von den Datenschutzaufsichtsbehörden des Bundes und der Länder folgende datenschutzrechtliche Anforderung formuliert:

„KI darf Menschen nicht zum Objekt machen“

Doch genau DAS zeichnet die Kampagne zur „Open-Source“-Plattform der Berliner Zeitung aus: sie reduziert den Mensch auf ein Objekt. Ein Objekt, das Trauer symbolhaft ausdrücken, und Klickreiz generieren soll. Der Ethikrat weist in seiner oben genannten Stellungnahme auf die Problematik einer solchen emotionalen Aufladung von Text- und Bildinformationen zum Zwecke der Steigerung der Reichweite hin. Die emotions-betonte, zudem stark moralisierende, wertende Bildsprache dient einzig dem Zweck, Aufmerksamkeit zu stiften.

Je emotionsgeladener eine Aussage, textlicher oder bildlicher Art, umso stärker reagieren wir als Mensch. In wissenschaftlichen Studien etwa zum Thema Social-Media-Content ist dieser durch Algorithmen angetriebene Trigger-Effekt gut dokumentiert. Und auf diesen Effekt setzt auch die Berliner Zeitung, indem sie in KI-generierten Motiven den dargestellten Personen in manipulativer Weise stark emotionsgeladene Gesichtsausdrücke andichtet.

Bildmanipulation hat es im Fotojournalismus schon immer gegeben. Als Mitte des 19. Jahrhunderts die fotografische Technik beherrschbar geworden war, wurden sogleich Fotomontagen und Bildcollagen mit nachgestellten Szenen angefertigt. Vom Tageslicht und der Öffentlichkeit abgeschirmt wurde im Labor mal hier eine Person wegretuschiert, dort ein unvorteilhaft wirkendes Objekt entfernt. Seit der DTP-Ära werden unpassend erscheinende Objekte, wie beispielsweise die Luxusuhr des ehemaligen Siemens-Chefs Klaus Kleinfeld, mit Bildbearbeitungsprogrammen retuschiert, „weg gephotoshopt“ sozusagen. Überhöhung und Überzeichnung, Dekonstruktion und Neukonstruktion, und Fotomontagen mit Personen des öffentlichen Lebens haben eine lange Tradition, im Journalismus und in der Kunst. Denn die Ursprünge liegen in der Malerei, in der es seit je her galt, Personen und Ereignisse möglichst vorteilhaft darzustellen (Könige, Priester), oder möglichst unvorteilhaft (Sünder, Ketzer), je nachdem.

Mit der Verfügbarkeit von KI-Technologie eröffnet sich auch in dieser Hinsicht eine völlig neue, schwer fassbare Dimension. #Neuland. Es scheint, als wiederhole sich Geschichte. Denn vor lauter Technikeifer stellt sich einmal mehr offenbar immer weniger die Frage, OB etwas gezeigt, gemacht, veröffentlicht, realisiert werden soll, sondern einzig WANN und in WIE. Schließlich möchte man dabei sein, als modern, angesagt und auf der Höhe der Zeit wahrgenommen werden. Der Hosting-Anbieter 1&1 bewirbt sein vorgefertigtes, konfektioniertes, auf starren Templates basierendes IONOS-Homepage-Tool als „Intuitives Baukastensystem mit KI-Unterstützung“. Im Vergleich zur BZ-Kampagne harmloses Werbe-Tamtam.

Mit KI-Bildgeneratoren wie Midjourney, Dall-E oder Stable Diffusion fotorealistische Abbildungen von realen Personen zu erstellen, ist die eine Sache. Die auf diese Weise erzeugten digitalen Abbildungen und Repliken zu verwenden, sie in einen konkreten Kontext zu stellen, ist die andere. Ebenso wie etwa bei der Erhebung von Daten zu KI-Trainingszwecken (Data Mining) zwischen der Nutzung für Forschungszwecke auf der einen Seite sowie der Nutzung für kommerzielle Zwecke auf der anderen Seite unterschieden wird, braucht es auch für die Nutzung von Medienerzeugnissen differenzierende Vorgaben und Schrankenregelungen.

Unbedingt braucht es darüber hinaus einen gesellschaftlichen Diskurs und, wenn nötig, Widerspruch. Denn ich bin mit der Kampagne nämlich nicht einverstanden. Auch weil die BZ-Motive nach meinem Empfinden die Menschenwürde und die Rechte auf Selbstbestimmung der dargestellten Personen verletzen. Wahrnehmung ist sehr individuell und verschieden. In meiner Wahrnehmung werden auf den Motiven die jeweiligen Personen, insbesondere Gandhi, in entstellender, entwürdigender Weise dargestellt. Der Umstand, dass der trauernde Gesichtsausdruck durch Promps den jeweiligen Prominenten verliehen, besser gesagt aufoktroyiert wurde, macht die Verwendung der Motive um so bedenklicher.

Stellen wir uns vor, eine reale Person, eine am Grab stehende trauernde Person, würde in ähnlicher Weise abgelichtet, in Nahaufnahme, mit Tränen in den Augen, und als Foto mit einer derart intensiven emotionalisierten Stilistik/Bildästhetik im Rahmen der Werbung oder der Berichterstattung verwendet. Wäre das denkbar? Wünschenswert? Sicherlich nicht. Schon gar nicht ohne Einwilligung der betroffenen Person. Da die Veröffentlichung einer solchen Aufnahme nach allgemeinem Verständnis eine Verletzung und Missachtung der Menschenwürde der betreffenden Person darstellt.

Das Angebot an KI-Werkzeugen, -Plugins und -Widgets wird zunehmend größer und unübersichtlicher, dennoch dürfen Menschenwürde, Persönlichkeitsrechte und Urheberrechte nicht übersehen werden. Nicht nur beim Prompt Engineering ist Fingerspitzengefühl gefragt, auch bei der Wahl der Mittel gilt es abzuwägen, ob etwas verwendet und genutzt werden kann/sollte/darf. Ohne einen gut justierten ethischen Kompass geht es nicht. Wenn sich derlei Abbildungen von stark emotionalisierten Repliken weiter in den Alltag einschleichen, ist es lediglich eine Frage der Zeit, bis auch Fotos von am Grab stehenden trauernden Menschen auf dem Cover von Magazinen und auf der Startseite von Nachrichtenportalen zu sehen sind (shifting baselines).

Dem Vorwurf der Vereinnahmung prominenter Personen ließe sich entgegnen, Apple habe in der berühmten „Think Different“-Kampagne (1997) selbiges mit Mahatma Gandhi, Alfred Hitchcock, Pablo Picasso, u.a. gemacht. Eben nicht! Die auf den Motiven und in TV-Spots dargestellten Personen sind real, dokumentieren diese in realen Situationen, mit realer Mimik und Gestus. Das Dargestellte und Gezeigte hat sich so tatsächlich ereignet. Mahatma Gandhi wird auf den Apple-Plakaten kein Ausdruck angedichtet, den er nicht artikuliert und vermittelt hat. Es werden keine Hände, Hautfalten, Augen und andere Körperteile arrangiert, überzeichnet und Bildstilistik dramatisiert. Abgebildet ist der Mensch, wie er war. Konstruiert ist lediglich der Kontext: die Verwendung der jeweiligen Person zu kommerziellen Zwecken, als ungefragtes Testimonial einer Marke. Ob diese Vereinnahmung und Art der Inszenierung in Ordnung und legitim ist, auch darüber lässt sich streiten. Im Gegensatz zur Berliner Zeitung betrieb Apple jedoch keine Bildmanipulation, und hat dem Betrachter kein X für ein U vorgegaukelt.

Abgesehen davon sehe ich in dem konzeptionellen-kreativen Ansatz der Kampagne, für deren Idee der namhafte Berliner Gestalter Raban Ruddigkeit verantwortlich zeichnet, mehrere Widersprüche. Die Berliner Zeitung verfolgt mit ihrer „Open Source“-Plattform das Ziel, so die Intention, Kommunikation und zwischenmenschlichen Dialog zu fördern. Eine feine Sache. Setzt dann allerdings in ihrer Kampagne auf Maschinen-generierte Motive, die, wie bereits erwähnt, eine stark wertende Bildsprache aufweisen. Anstatt beispielsweise Menschen im Dialog zu zeigen, die meinungsoffen ihre Gedanken austauschen (in welcher Art/Stilistik auch immer), werden digitale Repliken in moralisierender Weise in Szene gesetzt, dabei (womöglich) Persönlichkeitsrechte missachtet, und aufmerksamkeitsheischende Deepfakes produziert. Schöne neue Welt.

Mediengalerie

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung „Open Source“ – Instagram Rabban Ruddigkeit, Quelle: Instagram

- Berliner Zeitung „Open Source“ – Facebook, Quelle: Facebook / Berliner Zeitung

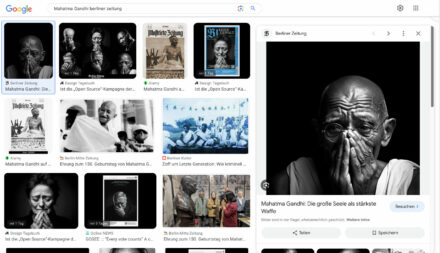

- Berliner Zeitung Gandhi Google, Quelle: Google

- Berliner Zeitung – MLK, Quelle: Berliner Zeitung

- Berliner Zeitung „Open Source“ – Instagram, Quelle: Instagram / Berliner Zeitung

- Berliner Zeitung Gandhi Google, Quelle: Google

tatsächlich unproblematisch oder vollends egal sind persönlichkeitsrechte in zeitgeschichte spätestens seit dem Caroline-von-Monaco-Urteil II (BVerfG) nicht.

wünschenswert wäre sicher zukünftigen KI.s die sozial ethik mitzugeben: eben nicht alles was irgendwie möglich ist – auch uneingeschränkt bzw. unreflektiert zu generieren.

Auch Urheberrechte sind zu berücksichtigen. Um solcherart Werke zu generieren wird das KI – Tool ja (auch) mit Bildern gefüttert deren Autoren davon nicht profitieren.

koni: Kommt auf das Tool an. Adobe behauptet ja z.B., dass Adobe Firefly nur mit freiem Bildmaterial trainiert wurde.

Herzlichen Dank an alle dt-Leser, die sich hier in konstruktiver Weise eingebracht haben!

Wenn von mir im Beitrag das Thema Urheberrecht weitestgehend ausgespart wurde, dies möchte ich noch einmal betonen, dann nicht etwa deshalb, weil es von mir als weniger wichtig angesehen wird. Ganz im Gegenteil. Im betreffenden Fall (BZ Bildmanipulation) stehen meines Erachtens jedoch andere Aspekte und Fragestellungen im Vordergrund, insbesondere ethische.

Ethische, rechtliche und wirtschaftliche Fragen sowie demokratische Risiken bezogen auf generative KI standen auch im Rahmen der 11. Urheberrechtskonferenz (Berlin) im Mittelpunkt, hier mit dem Fokus auf das Urheberrecht. 28 Referentinnen sprachen über die Verbreitung von Deepfakes, Desinformation, über Vertrauensverlust in Werke, Stimmen oder Nachrichten. In ihrer KI-Stellungnahme betont die Initiative Urheberrecht, Veranstalter der Konferenz, dass „das immanente Desinformations- und Manipulationspotenzial generativer KI-Systeme jeden Einzelnen und die Gesellschaft insgesamt vor tiefgreifende Herausforderungen stellt.“

Der Live-Stream vom 27.11.2023 mit allen Redebeiträgen steht als Video zur Verfügung.

11. Urheberrechtskonferenz 27. November 2023 from Crck / Felix Schnetzer on Vimeo.

Ich betrachte die im Kommentar geäußerten Bedenken als moralin-anachronistisches und selbstgerechtes Geschluchze. „Wer nicht mit der Zeit geht, geht mit der Zeit“! Oder anders gesagt, ein jeder hat seinen ganz persönlichen Moment im Leben, wo er zum Ewiggestrigen erstarrt – man muss ihn nur ehrlich erkennen wollen.

Diese KI-Gesichter sind bei genauer – und vor allem intuitiver Beobachtung – eigentlich sofort als bewusst manipulative Illustrationen zu lesen. Wenn man es denn will. Und das macht für mich ja überhaupt erst den garantiert absichtlich provokativen Reiz aus. Allein die Ballung der sechs historischen Persönlichkeiten auf eine kleinen Fläche, dann die plastik-glatten Physiognomien sowie die überzogenen „Emotionen“, die sofort als unecht entlarvbar sind, geben dem Konzept in meinen Augen einen gelungenen und zeitgenössischen Schliff!

Jeder kennt diese sechs Persönlichkeiten längst von unzähligen Fotos, anhand derer man nämlich mit der Zeit ein untrügliches inneres Gespür entwickelt hat, wie sich diese Personen in ihrer typischen Mimik und Gestik meistens präsentiert hatten. Und da fällt diese übertrieben gefühlige und fast schon weinerliche Pose sofort als „unnatürlich falsch“ auf. So haben sie sich nie öffentlich gezeigt, ist der erste Reflex, den man verspürt, wenn man diese künstlichen „Fotos“ sieht. Auch die gummihafte Haut und die serienartige Ähnlichkeit der Abbildungen lässt einen unmittelbar skeptisch werden.

Ich glaube, dass wir Menschen eine unkompromittierbare Antenne für solche Deepfakes haben – es sein denn, wir wollen unbedingt glauben, was wir da sehen. Ich würde diese innere Warnanlage das „visuelle Gewissen“ des Menschen nennen. Oder ganz klassisch „Bauchgefühl“. Für mich ist dieses Konzept jedenfalls ein gelungener Coup!

Jeder? Im Grunde steht der Kommentar stellvertretend für so viele Reaktionen im Netz, in denen pseudoargumentativ und pauschalisierend irrige Annahmen für Fakten gehalten und verkauft werden. Stichwort Filterblase. Einfach mal mit realen Fotos der Personen durch die Einkaufpassage gehen und Passanten fragen, ob sie diese kennen. „Jeder“ relativiert sich dann sehr schnell. Einige der hier in entstellender Weise gezeigten Persönlichkeiten dürfte im Rahmen einer solcher „Feldstudie“ kaum jemand kennen. Gerade bei den Jüngeren werden Abbildungen von Rabin, Havel oder Bohley, so meine Vermutung, eher Schulterzucken hervorrufen.

„Deepfakes“ – gut, dass hier immerhin das Kind beim Namen genannt wird. Doch sooo unkompromittierbar scheint die Antenne von „uns Menschen“ angesichts von QAnon und der Fantastereien auch hierzulande im Reichsbürgertum nicht zu sein. Mein Bauchgefühl sagt mir, dass Aufklärung, Richtigstellung und Einordnung mehr denn je gefragt sind. Am 6. Januar 2021 hatte die „Warnanlage“ wohl einen Aussetzer.

Da die Bilder, wie aufgezeigt, im Netz ein Eigenleben entwickeln und zunehmend SOLITÄR auftreten, taugt die serielle Machart und optische Ähnlichkeit nicht als Kriterium, um ein Bild als Fake zu überführen.

************** dt-Hinweis ****************

Der Kommentar wurde gelöscht. Bitte die Netiquette beachten und sachbezogen und fair kommentieren.

Herzlichen Dank.

******************************************

[…] die Antwort auf Fake News können nicht immer mehr Maschinen-generierte Repliken und Motive mit Deepfake-Charakter sein. Vor dem Hintergrund der weiter voranschreitenden Demokratisierung von Design kristallisieren […]