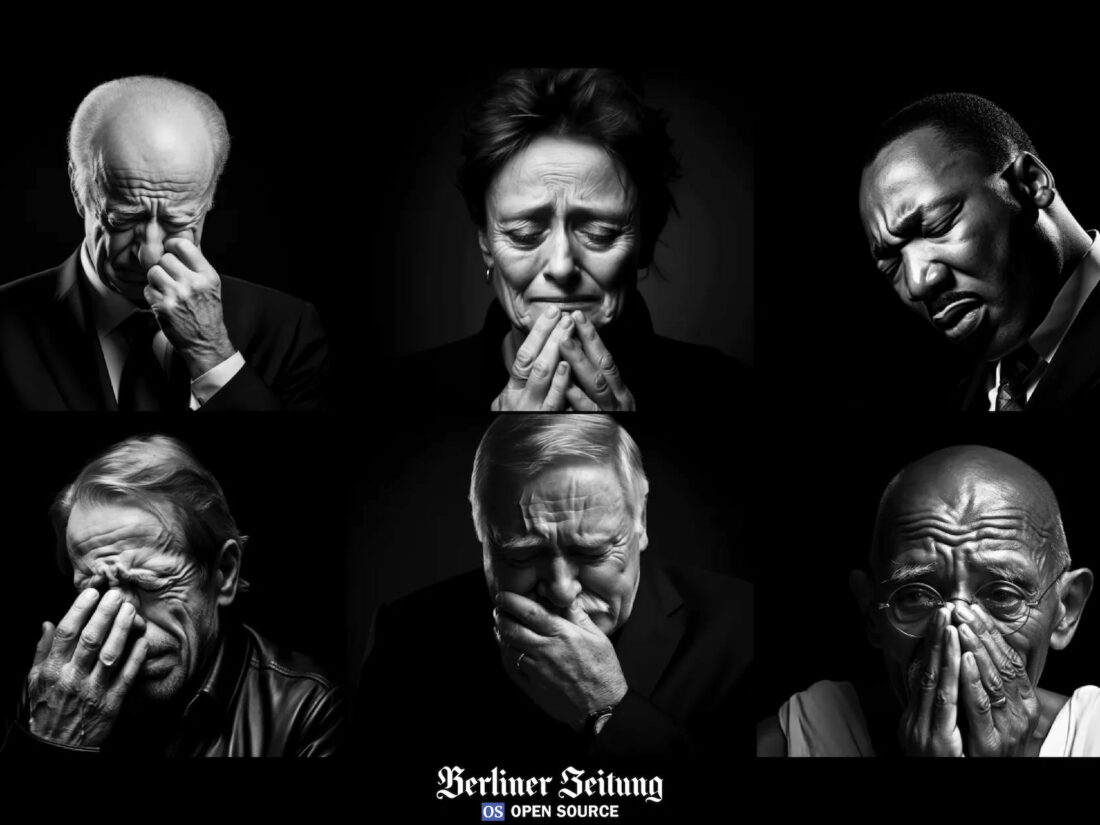

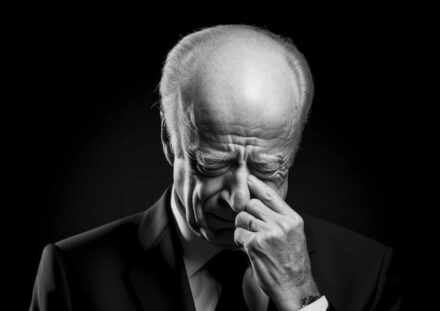

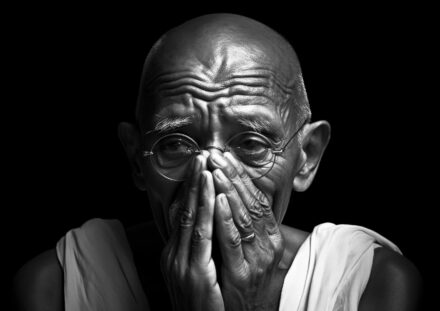

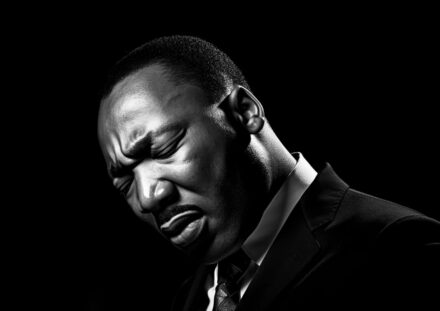

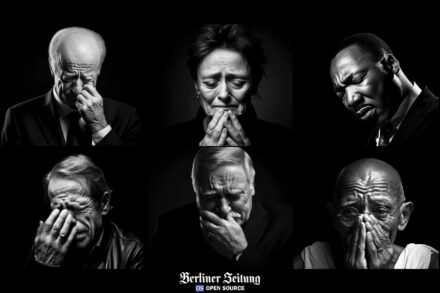

Die Berliner Zeitung hat unter der Bezeichnung „Open Source“ eine digitale Plattform online gestellt, auf der freie Autoren Beiträge veröffentlichen können. Beworben wird die Plattform mit Motiven, die von KI-Bildgeneratoren erstellt wurden und prominente Personen darstellen. Auf den Motiven sind (mutmaßlich) Mahatma Gandhi, Václav Havel, Bärbel Bohley und Martin Luther King und andere Persönlichkeiten mit stark emotionalisierter Mimik/Gestik zu sehen. Eine in vielerlei Hinsicht bedenkliche, da grenzüberschreitende Kampagne. Ein Kommentar.

Seit einigen Tagen ist unter der URL berliner-zeitung.de/open-source/ eine digitale Plattform der Berliner Zeitung online. Sinn und Zweck der Plattform wird von der Berliner Zeitung wie folgt beschrieben:

Mit Open Source gibt der Berliner Verlag freien Autorinnen und Autoren sowie jedem Interessierten die Möglichkeit, Texte mit inhaltlicher Relevanz und professionellen Qualitätsstandards anzubieten. Ausgewählte Beiträge werden veröffentlicht und honoriert.

Beworben wird die Plattform mit von KI-Bildgeneratoren erstellten Motiven, die prominente Personen darstellen. Die Macher erläutern die Kampagnenidee wie folgt:

Wir haben uns gefragt: Was ist aus dem Geist der friedlichen Revolution geworden, der zum Mauerfall vom 9. November 1989 führte, der die Proteste und Veränderungen zuvor in Ost-Berlin, Prag, Warschau und anderswo trug? Wie würden Bürgerrechtler und Friedensaktivisten, die sich für Gewaltfreiheit, Debatte und Dialog einsetzten – wie die Bürgerrechtlerin und Gründerin des „Neuen Forum“, Bärbel Bohley – auf das Heute blicken, auf die aktuelle Weltlage? Auf Russlands Krieg in der Ukraine, auf die Gewalteskalation im Nahen Osten?

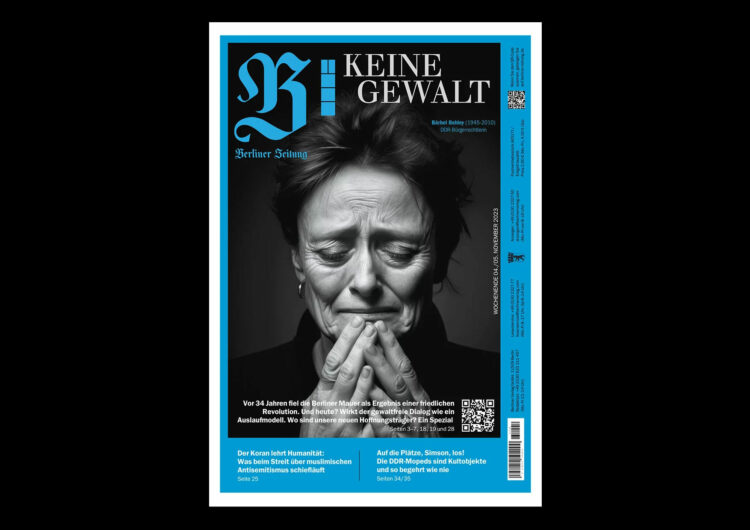

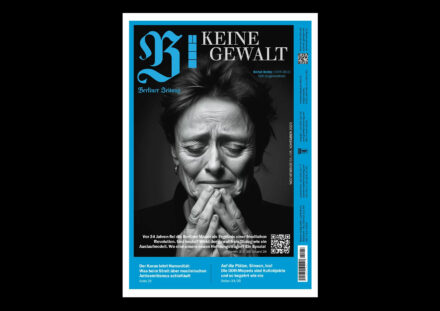

Die Wochenendausgabe der Berliner Zeitung vom 4. und 5. November 2023 ziert eines der Motive. Abgebildet ist eine Darstellung von Bärbel Bohley. Die Abbildung ist mit der Bildunterschrift „Bärbel Bohley (1945-2010) DDR-Bürgerrechtlerin“ versehen. Dass es sich bei dem Motiv um eine mit Hilfe von Künstlicher Intelligenz erzeugten nicht-realen Darstellung von Bärbel Bohley handelt, ist auf dem Cover nicht ersichtlich.

Die Kampagne wirft viele gesellschaftlich hochrelevante Fragen auf. Etwa, ob die Persönlichkeitsrechte der gezeigten Menschen verletzt wird. Inwieweit Deepfakes als Stilmittel der Freiheit der Kunst bzw. der freien Meinungsäußerung angesehen werden können. Denn nichts anderes stellen die Motive der Kampagne dar: Deepfakes.

Es findet, nach meinem Ermessen, eine Vereinnahmung der abgebildeten Personen zu kommerziellen Zwecken statt. Möglicherweise tangiert die Kampagne auch das Thema Urheberrecht. Dies wäre der Fall, wenn das gezeigte Bildsujet die Handschrift eines Fotografen trüge, wenn es besondere stilistische Merkmale aufwiese, die sich einem bestimmten Urheber zuschreiben ließen. Um den Rahmen nicht zu sprengen, verzichte an dieser Stelle auf eine nähere Untersuchung. Wer die Motive in dieser Hinsicht genauer unter die Lupe nehmen mag – in den Kommentaren ist reichlich Platz. Ich würde mich sehr freuen. Ich möchte jedoch weiter auf den Aspekt der Werbung mit bekannten Personen eingehen.

Der Deutsche Werberat, eine seit 1972 bestehende Selbstkontrolleinrichtung der Werbewirtschaft, definiert in dem von ihm verfassten Werbekodex die Richtlinie für Werbung mit Prominenten wie folgt:

In der Werbung dürfen Bilder und /oder Namen von Menschen oder sonstige dem Persönlichkeitsbereich zuzurechnende Darstellungen nur mit deren Zustimmung verwandt werden. Eine Ausnahme von diesem Erfordernis kommt nur dann in Betracht, wenn es sich – wie bei Bundespolitikern – um so genannte Personen der Zeitgeschichte handelt und erkennbar der Informations- und Dokumentationszweck, nicht aber das Geschäftsinteresse, im Vordergrund steht.

Zweifelsfrei handelt es sich bei den in der BZ-Kampagne dargestellten Personen um Personen von zeitgeschichtlicher Bedeutung. Da bis auf Lech Wałęsa bereits alle Personen tot sind, stellt sich die Frage nach der Zustimmung zur Verwendung nicht. Es ist davon auszugehen, dass es keine gibt. Eindeutig ist, dass die Kampagne einem Geschäftsinteresse dient.

Dass prominente Menschen mitunter hinnehmen müssen, im Rahmen von Werbung vereinnahmt zu werden, durfte beispielsweise Claus Weselsky erfahren. Der Chef der Lokführergewerkschaft (GDL) muss eine Werbung des Autovermieters Sixt mit seinem Foto und der Bezeichnung „Mitarbeiter des Monats“ hinnehmen, so jedenfalls entschied es das Landgericht Leipzig in einem Urteil 2018. Als zentrales Argument führte das Gericht an, Adressaten würden den satirischen Charakter der Werbung erkennen.

Einen satirischen Charakter weist die BZ-Kampagne nicht auf. Auch ist für Leser nicht zu erkennen, dass die Motive nicht etwa reale Personen abbilden. Denn eine entsprechende Kennzeichnung fehlt. Dargestellt sind nicht etwa Jitzchak Rabin, Bärbel Bohley, Martin Luther King, Václav Havel, Lech Wałęsa und Mahatma Gandhi, sondern lediglich Nachbildungen dieser Personen, künstlich erzeugte digitale Repliken. Diese Information bleibt die Berliner Zeitung dem Betrachter schuldig.

Die Differenzierung zwischen Mensch und Replik ist im Hinblick auf die Rezeption von KI-generierten Inhalten immanent. René Magritte wies in seinem berühmten Werk „Der Verrat der Bilder“ darauf hin, dass das Dargestellte nicht der Realität entspricht („Ceci n’est pas une pipe“, zu deutsch: „Dies ist keine Pfeife“). Auf dem oben gezeigten BZ-Cover ist NICHT die DDR-Bürgerrechtlerin und Malerin Bärbel Bohley abgebildet. Es zeigt eine Replik. Die Bildunterschrift ist falsch.

Heutzutage ist es selbst für Experten und Faktenchecker mitunter eine Herausforderung, zu benennen, was echt und was Fake ist. Bilder und Grafiken, Musikstücke, Stimmen, Darsteller, Texte und andere mit Hilfe von KI-Engines angefertigten Erzeugnisse, die von Menschen geschaffene Werke nachbilden, sollten so aufbereitet werden, dass Leser, Zuschauer, Konsumenten und Anwender erkennen können, dass es sich um Maschinen-gemachte Objekte und Produkte handelt. Eine Kennzeichnung ist überdies schon allein der journalistischen Sorgfaltspflicht wegen geboten, denn es handelt sich im konkreten Fall um eine Form der Bildmanipulation.

Unter dem Motto „KI aber fair“ haben Design- und Kreativverbände, Organisationen, Medien und Privatpersonen im Frühjahr 2023 eine Vorgabe hinsichtlich der Kennzeichnungspflicht für KI-generierte Medien formuliert (mit Fokus auf Urheberrechte). Das dt gehört zu den Erstunterzeichnern. Aus dem Positionspapier zitierend:

Wir fordern eine Kennzeichnungspflicht für KI-generierte Erzeugnisse. Für Nutzende muss schnell und eindeutig ersichtlich sein, ob ein Text, ein Bild, Musikstück oder Video von Menschen erstellt und geprüft oder durch KI generiert wurde. Ein Höchstmaß an Transparenz bei allen Aspekten der Entwicklung, Produktion und Bereitstellung ist sowohl für die Nutzenden erforderlich als auch für die Kreativschaffenden, damit sie ggf. ihr Recht am eigenen Werk wahrnehmen können

Im Rahmen seiner Stellungnahme „Mensch und Maschine“ (PDF) hat auch der Deutsche Ethikrat im Februar 2023 die Bedeutung von Transparenz im Zusammenhang mit Künstlicher Intelligenz betont. Menschliche Autorschaft gelte es zu stärken, den Einsatz von KI-Systemen „hinreichend transparent und nachvollziehbar“ zu machen. Dieser Empfehlung (mit Fokus auf Urheberrechte) hat sich auch der Deutsche Kulturrat im Juni 2023 angeschlossen. Und dieser Transparenzpflicht kommt die Berliner Zeitung in ihrer Kampagne nicht in erforderlichem Umfang nach.

Nach wie vor wird der Einsatz Künstlicher Intelligenz kaum reguliert. Der Verordnungsvorschlag der EU-Kommission zur Festlegung harmonisierter Vorschriften für Künstliche Intelligenz (Gesetz über Künstliche Intelligenz, AI-Act) wurde zwar im Juni 2023 vorgelegt, aktuell hat der Vorschriftenentwurf jedoch keine gesetzgeberische Funktion. Mit der Ratifizierung des Entwurfs – diese scheint in weite Ferne gerückt, da sich Deutschland, Frankreich und Italien querstellen – ist die Debatte gleichwohl nicht beendet. Vermutlich wird sie niemals enden, was gut wäre. Für und Wider gilt es heute wie morgen abzuwägen, und immer wieder neu zu verhandeln, denn die Technologie entwickelt sich rasend schnell weiter. Es gibt viel zu diskutieren, zu hinterfragen, anzupassen, neu zu strukturieren, zu überarbeiten, aufzubereiten und zu regeln.

So müssen auch die vom Werberat formulierten „Grundregeln zur kommerziellen Kommunikation“, im Jahr 2007 verfasst, als stark reformbedürftig bezeichnet werden. Denn der sogenannte Werbekodex enthält keinerlei Aussagen zum Themenkomplex Künstliche Intelligenz. Nicht nur Betriebe der Kreativwirtschaft sind gut damit beraten, den Umgang mit KI-Technologie für sich zu definieren und zu regeln, seien es Verlags- und Medienhäuser, Agenturen, Unternehmen mit Grafikabteilungen, Spieleentwickler, Fotostudios, Kommunikations- und PR-Abteilungen oder Musik- und Tonstudios. Da Künstliche Intelligenz nahezu in allen Bereichen des öffentlichen und privaten Lebens Einzug gehalten hat, müssen sich im Grunde alle Unternehmen, Gewerbetreibende, alle Marktteilnehmer, alle Künstler und Kreativschaffende zum Thema KI positionieren, besser heute als morgen.

So wie es kürzlich US-amerikanische Schauspieler getan haben. Mit ihrem von der Gewerkschaft „Screen Actors Guild (SAG)“ organisierten viermonatigen Streik haben sie erreicht, dass der Einsatz von KI-Technologie in ihrer Arbeitswelt geregelt und begrenzt wird. Zukünftig erfolgt, so die Einigung, „für die Erstellung und Nutzung digitaler Repliken lebender und verstorbener SAG-Mitglieder, unabhängig davon, ob diese am Set erstellt oder für die Nutzung lizenziert wurden, eine Vergütung“. Die Nutzung digitaler Repliken setzt also die Zustimmung der jeweiligen Schauspieler voraus (bzw. deren Nachkommen, Nachlassverwalter, Rechteinhaber, u.a.). Vorbildcharakter auch für andere Branchen, in anderen Ländern? Unbedingt.

In der sogenannten „Hambacher Erklärung zur Künstlichen“ (PDF), bereits im April 2019 verfasst, wurde von den Datenschutzaufsichtsbehörden des Bundes und der Länder folgende datenschutzrechtliche Anforderung formuliert:

„KI darf Menschen nicht zum Objekt machen“

Doch genau DAS zeichnet die Kampagne zur „Open-Source“-Plattform der Berliner Zeitung aus: sie reduziert den Mensch auf ein Objekt. Ein Objekt, das Trauer symbolhaft ausdrücken, und Klickreiz generieren soll. Der Ethikrat weist in seiner oben genannten Stellungnahme auf die Problematik einer solchen emotionalen Aufladung von Text- und Bildinformationen zum Zwecke der Steigerung der Reichweite hin. Die emotions-betonte, zudem stark moralisierende, wertende Bildsprache dient einzig dem Zweck, Aufmerksamkeit zu stiften.

Je emotionsgeladener eine Aussage, textlicher oder bildlicher Art, umso stärker reagieren wir als Mensch. In wissenschaftlichen Studien etwa zum Thema Social-Media-Content ist dieser durch Algorithmen angetriebene Trigger-Effekt gut dokumentiert. Und auf diesen Effekt setzt auch die Berliner Zeitung, indem sie in KI-generierten Motiven den dargestellten Personen in manipulativer Weise stark emotionsgeladene Gesichtsausdrücke andichtet.

Bildmanipulation hat es im Fotojournalismus schon immer gegeben. Als Mitte des 19. Jahrhunderts die fotografische Technik beherrschbar geworden war, wurden sogleich Fotomontagen und Bildcollagen mit nachgestellten Szenen angefertigt. Vom Tageslicht und der Öffentlichkeit abgeschirmt wurde im Labor mal hier eine Person wegretuschiert, dort ein unvorteilhaft wirkendes Objekt entfernt. Seit der DTP-Ära werden unpassend erscheinende Objekte, wie beispielsweise die Luxusuhr des ehemaligen Siemens-Chefs Klaus Kleinfeld, mit Bildbearbeitungsprogrammen retuschiert, „weg gephotoshopt“ sozusagen. Überhöhung und Überzeichnung, Dekonstruktion und Neukonstruktion, und Fotomontagen mit Personen des öffentlichen Lebens haben eine lange Tradition, im Journalismus und in der Kunst. Denn die Ursprünge liegen in der Malerei, in der es seit je her galt, Personen und Ereignisse möglichst vorteilhaft darzustellen (Könige, Priester), oder möglichst unvorteilhaft (Sünder, Ketzer), je nachdem.

Mit der Verfügbarkeit von KI-Technologie eröffnet sich auch in dieser Hinsicht eine völlig neue, schwer fassbare Dimension. #Neuland. Es scheint, als wiederhole sich Geschichte. Denn vor lauter Technikeifer stellt sich einmal mehr offenbar immer weniger die Frage, OB etwas gezeigt, gemacht, veröffentlicht, realisiert werden soll, sondern einzig WANN und in WIE. Schließlich möchte man dabei sein, als modern, angesagt und auf der Höhe der Zeit wahrgenommen werden. Der Hosting-Anbieter 1&1 bewirbt sein vorgefertigtes, konfektioniertes, auf starren Templates basierendes IONOS-Homepage-Tool als „Intuitives Baukastensystem mit KI-Unterstützung“. Im Vergleich zur BZ-Kampagne harmloses Werbe-Tamtam.

Mit KI-Bildgeneratoren wie Midjourney, Dall-E oder Stable Diffusion fotorealistische Abbildungen von realen Personen zu erstellen, ist die eine Sache. Die auf diese Weise erzeugten digitalen Abbildungen und Repliken zu verwenden, sie in einen konkreten Kontext zu stellen, ist die andere. Ebenso wie etwa bei der Erhebung von Daten zu KI-Trainingszwecken (Data Mining) zwischen der Nutzung für Forschungszwecke auf der einen Seite sowie der Nutzung für kommerzielle Zwecke auf der anderen Seite unterschieden wird, braucht es auch für die Nutzung von Medienerzeugnissen differenzierende Vorgaben und Schrankenregelungen.

Unbedingt braucht es darüber hinaus einen gesellschaftlichen Diskurs und, wenn nötig, Widerspruch. Denn ich bin mit der Kampagne nämlich nicht einverstanden. Auch weil die BZ-Motive nach meinem Empfinden die Menschenwürde und die Rechte auf Selbstbestimmung der dargestellten Personen verletzen. Wahrnehmung ist sehr individuell und verschieden. In meiner Wahrnehmung werden auf den Motiven die jeweiligen Personen, insbesondere Gandhi, in entstellender, entwürdigender Weise dargestellt. Der Umstand, dass der trauernde Gesichtsausdruck durch Promps den jeweiligen Prominenten verliehen, besser gesagt aufoktroyiert wurde, macht die Verwendung der Motive um so bedenklicher.

Stellen wir uns vor, eine reale Person, eine am Grab stehende trauernde Person, würde in ähnlicher Weise abgelichtet, in Nahaufnahme, mit Tränen in den Augen, und als Foto mit einer derart intensiven emotionalisierten Stilistik/Bildästhetik im Rahmen der Werbung oder der Berichterstattung verwendet. Wäre das denkbar? Wünschenswert? Sicherlich nicht. Schon gar nicht ohne Einwilligung der betroffenen Person. Da die Veröffentlichung einer solchen Aufnahme nach allgemeinem Verständnis eine Verletzung und Missachtung der Menschenwürde der betreffenden Person darstellt.

Das Angebot an KI-Werkzeugen, -Plugins und -Widgets wird zunehmend größer und unübersichtlicher, dennoch dürfen Menschenwürde, Persönlichkeitsrechte und Urheberrechte nicht übersehen werden. Nicht nur beim Prompt Engineering ist Fingerspitzengefühl gefragt, auch bei der Wahl der Mittel gilt es abzuwägen, ob etwas verwendet und genutzt werden kann/sollte/darf. Ohne einen gut justierten ethischen Kompass geht es nicht. Wenn sich derlei Abbildungen von stark emotionalisierten Repliken weiter in den Alltag einschleichen, ist es lediglich eine Frage der Zeit, bis auch Fotos von am Grab stehenden trauernden Menschen auf dem Cover von Magazinen und auf der Startseite von Nachrichtenportalen zu sehen sind (shifting baselines).

Dem Vorwurf der Vereinnahmung prominenter Personen ließe sich entgegnen, Apple habe in der berühmten „Think Different“-Kampagne (1997) selbiges mit Mahatma Gandhi, Alfred Hitchcock, Pablo Picasso, u.a. gemacht. Eben nicht! Die auf den Motiven und in TV-Spots dargestellten Personen sind real, dokumentieren diese in realen Situationen, mit realer Mimik und Gestus. Das Dargestellte und Gezeigte hat sich so tatsächlich ereignet. Mahatma Gandhi wird auf den Apple-Plakaten kein Ausdruck angedichtet, den er nicht artikuliert und vermittelt hat. Es werden keine Hände, Hautfalten, Augen und andere Körperteile arrangiert, überzeichnet und Bildstilistik dramatisiert. Abgebildet ist der Mensch, wie er war. Konstruiert ist lediglich der Kontext: die Verwendung der jeweiligen Person zu kommerziellen Zwecken, als ungefragtes Testimonial einer Marke. Ob diese Vereinnahmung und Art der Inszenierung in Ordnung und legitim ist, auch darüber lässt sich streiten. Im Gegensatz zur Berliner Zeitung betrieb Apple jedoch keine Bildmanipulation, und hat dem Betrachter kein X für ein U vorgegaukelt.

Abgesehen davon sehe ich in dem konzeptionellen-kreativen Ansatz der Kampagne, für deren Idee der namhafte Berliner Gestalter Raban Ruddigkeit verantwortlich zeichnet, mehrere Widersprüche. Die Berliner Zeitung verfolgt mit ihrer „Open Source“-Plattform das Ziel, so die Intention, Kommunikation und zwischenmenschlichen Dialog zu fördern. Eine feine Sache. Setzt dann allerdings in ihrer Kampagne auf Maschinen-generierte Motive, die, wie bereits erwähnt, eine stark wertende Bildsprache aufweisen. Anstatt beispielsweise Menschen im Dialog zu zeigen, die meinungsoffen ihre Gedanken austauschen (in welcher Art/Stilistik auch immer), werden digitale Repliken in moralisierender Weise in Szene gesetzt, dabei (womöglich) Persönlichkeitsrechte missachtet, und aufmerksamkeitsheischende Deepfakes produziert. Schöne neue Welt.

Mediengalerie

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

- Berliner Zeitung Kampagne „Open Source“, Quelle: Berliner Zeitung

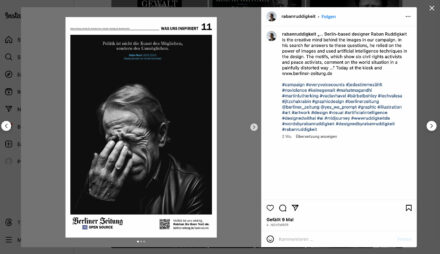

- Berliner Zeitung „Open Source“ – Instagram Rabban Ruddigkeit, Quelle: Instagram

- Berliner Zeitung „Open Source“ – Facebook, Quelle: Facebook / Berliner Zeitung

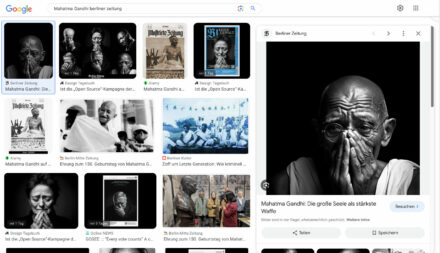

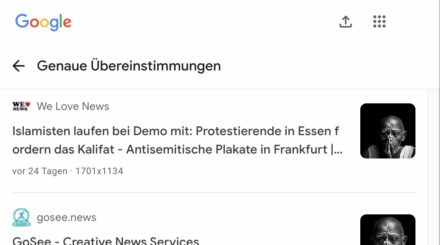

- Berliner Zeitung Gandhi Google, Quelle: Google

- Berliner Zeitung – MLK, Quelle: Berliner Zeitung

- Berliner Zeitung „Open Source“ – Instagram, Quelle: Instagram / Berliner Zeitung

- Berliner Zeitung Gandhi Google, Quelle: Google

Sehr guter Artikel. Vielen Dank dafür!

Das Problem ist natürlich die Faszination die von den möglichkeiten der KI ausgeht. Wir können im Zweifel die realität gar nicht mehr erkennen. Von den Persönlichkeitsrechten ganz zu schweigen.

Vielen Dank für die Kommentare, für die Einschätzungen aus Eurer Sicht!

@Lukas Dank Dir für die Anregung.

Mir ist wichtig, dass hierzu eine öffentliche Debatte stattfindet. Heute, jetzt. Nicht erst in einem halben Jahr.

Eine Beschwerde an den Werberat mündet, im „besten Fall“, in eine öffentliche Rüge. Ein, zwei Mal im Jahr spricht der Werberat in einer Pressemeldung mehrere dieser Rügen aus. Mit etwas Glück wird eine dieser (eher seltenen) Pressemeldungen des Werberates von Nachrichtenmedien aufgegriffen. In einem kurzen Beitrag werden schließlich in einer kompakten Zusammenfassung (Beispiel FAZ) Statistiken zu den Beschwerden aufgezählt, so und so viele Beschwerden, zu jenen Themen, Schwerpunkt meist sexistische Werbung. Zwischen dem Zeitpunkt des Absendens einer Beschwerde bis zu jenem Tag, an dem das Thema von Nachrichtenmedien (hoffentlich) aufgegriffen und von Lesern diskutiert wird, liegen mehrere Monate. In der Zwischenzeit sind KI-Tools mindestens eine Versionsstufe weiter. Ein Dilemma.

Ich sehe eine Einrichtung wie den Werberat für die heutigen Herausforderungen schon allein deshalb nicht gut aufgestellt, da dieser abgesehen von einem Kontaktformular auf seiner Website keine andere Möglichkeit bietet, um die Beschwerde zu formulieren, beispielsweise eben auch eine, die öffentlich ist. Soweit ich das sehe, hält der Werberat tatsächlich keinerlei Accounts im Umfeld von Social Media, nicht einmal Facebook wird als Sprachrohr genutzt, geschweige denn TikTok oder YouTube.

Auch deshalb, nicht nur der von mir im dt-Beitrag beschriebenen Defizite hinsichtlich fehlender KI-Vorgaben wegen, stellt sich letztlich die Frage, ob der Werberat überhaupt über die erforderliche Medienkompetenz verfügt. Falls ja, so ist diese nicht sichtbar.

Ich würde mich sehr freuen, wenn die Debatte weitergeführt, geteilt und weitergedacht wird.

Hi Achim,

danke für die ausführlichen Erläuterungen zum Werberat. Tatsächlich ist es schon Jahre her, dass ich selbst mal eine Beschwerde dort eingereicht habe, mich hatte nur der direkte Verweis auf die Richtlinien darauf gebracht. Was du beschreibst, hört sich ja wirklich alles andere als zielführend und wirksam an. Mann oh Mann. Wenigstens hast du mich damit etwas aufgeschlaut ;-) danke fürs drauf eingehen.

Die öffentliche Debatte, sowie in entsprechenden Fachkreisen, ist in der Tat viel wichtiger um das Thema zeitnah und von allen Standpunkten einzugrenzen!

LG Lukas

Sehr gerne. Sonst google vielleicht mal, ob das Thema, zu dem Du damals eine Beschwerde eingereicht hast, in irgendeiner Weise als Kritik/Rüge öffentlich sichtbar geworden ist. Würde mich interessieren. Gab es seitens des Werberates eine Reaktion, die über „Danke, wir haben Ihre E-Mail erhalten“ hinausgegangen ist?

Ja, ich hatte in der Tat eine Rückmeldung vom Werberat erhalten, in der sogar eine kurze Begründung enthalten war, warum meine Beschwerde abgelehnt bzw. nicht weiter verfolgt wurde (auch wenn ich die dürftig fand, aber darum geht’s ja nicht). Da das aber schon Jahre her ist, hab ich die Details nicht mehr so im Kopf, aber man erhält (so war es zumindest damals) tatsächlich Bescheid, was mit der eingegangenen Beschwerde passiert.

Hallo Achim und hallo liebe Leser, ich möchte nur ganz kurz folgendes richtigstellen: Natürlich wird sowohl in den Bildunterschriften als auch im Text zur Kampagne in Print auf Seite 3 und ebenso online ausdrücklich darauf verwiesen, dass die Bilder mithilfe von KI erstellt wurden. Das liegt der Redaktion und mir persönlich sehr am Herzen und es ist schade, dass das hier so mißverständlich beschrieben wird.

Raban Ruddigkeit

Hallo Raban, schön, dass Du dies klarstellst. Mich würde es sehr interessieren, was Du über den von Achim erhobenen Vorwurf, Ihr würdet Menschen zu Objekten machen und damit deren Menschenwürde verletzen, denkst. Ich wäre Dir dankbar, wenn Du dazu ein paar Zeilen schreiben würdest!

Es handelt sich bei den zeithistorischen Personen ausschließlich um solche, die mit ihrer unbedingten Friedenshaltung für die Kraft der Kommunikation stehen. Und die Kraft von gewaltfreier Veränderung. Die Rubrik OPEN SOURCE der Berliner Zeitung steht für die Offenheit gegenüber unterschiedlichen Standpunkten und Wertvorstellungen. Deshalb werden sie – in meinem Dafürhalten – nicht zum Objekt gemacht, sondern zum Subjekt, das für eine Haltung steht.

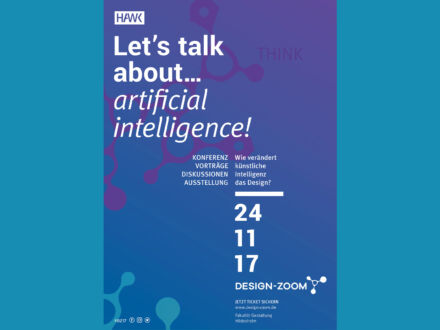

Zu Thema Ethik und KI streite ich mich seit einem Jahr zu oft in einem verkürzten Schwarzweiss-Schema, um darauf in so einem Podium umfassend antworten zu können. Man sollte so etwas tatsächlich mal zum Thema einer tiefgreifenden Auseinandersetzung machen. Da ich mich seit einem Jahr auch tätig mit KI auseinandersetze, stehe ich dafür gern zur Verfügung. Habe schon ein paar Vorträge zum Thema gehalten und wenn man sich etwas Zeit nimmt, wird man dem Thema deutlich gerechter.

Hallo Herr Ruddigkeit,

nun, hier haben wir allen Raum und alle Zeit der Welt. Lassen Sie es uns versuchen…

Sie haben recht, die abgebildeten Personen stehen symbolhaft für eine bestimmte Haltung. Aber schon die Vereinnahmung dieser Haltung mit dem Redaktionsprodukt “Open Source” der Berliner Zeitung ist mehr als schief. Bei letzterem scheint nicht nur der Name irreführend – auch eine pazifistische Grundhaltung ist meinem Verständnis nach nicht Teil dieses Konzepts.

Aber die Frage, in wie weit das Konzept von Bild und Botschaft hier aufgeht, aussen vor: Gewichtiger scheint mir doch, wie Sie es rechtfertigen, Personen der Zeitgeschichte vor den Karren einer schnöden Produktwerbung zu spannen? Ohne deren Einverständnis, ohne satirischen oder sonstigen inhaltlichen Bezug. Ich persönlich sehe darin einen Missbrauch von Persönlichkeitsrechten und etwas weiter gefasst auch eine Profanisierung der Haltung für die diese Menschen stehen.

Die Tatsache, dass hier KI Technologie genutzt wurde um das Konzept zu realisieren, ist ein für sich stehendes Thema, dass all die bekannten Fragen um die ethischen Probleme der Technologie und deren Anwendung beinhaltet. Einen Aspekt, die bewusste und absichtsvolle Täuschung der Öffentlichkeit, das Fake-News-Potential, führen Sie uns beispielhaft vor.

Ich würde mich über einen Austausch freuen,

Jürgen Gawron

Vielen Dank, Raban! Dass die Personen für eine Haltung stehen, wird in der Tat deutlich. Und durch die Reduktion wird dies sehr stark zum Ausdruck gebracht. Diese Qualität kann man der Kampagne kaum absprechen.

Wenn KI-generierte Werke als solche ausreichend gekennzeichnet sind halte ich KI auch im Bereich Gestaltung für ein legitimes und auch nützliches Werkzeug. Die Gefahr Deepfakes zu kreieren ist aber so simpel geworden dass es schon auch ein wirksames Instrumentarium braucht um Missbrauch zu verhindern.

Möchte aber das hier diskutierte Beispiel auch gestalterisch bewerten. Einer KI-Kennzeichnung hätte es eh kaum gebraucht. Schreit ja eh „KI”. Was mich tatsächlich stört ist die Maniriertheit in der Darstellung der Persönlichkeiten die sie eher karikiert als dass sie deren Haltung herausarbeiten würde.

Herzlichen Dank Raban.

Wie schön, dass Du hier in die Diskussion einsteigst.

(ich bleibe auch bei der Anrede mit Vornamen und beim Du)

An einem Austausch mit Dir (oder mit der BZ-Redaktion) liegt mir tatsächlich mehr, als an einer Beschwerde an den Werberat, wie von Lukas angeregt.

Vielleicht magst Du präzisieren, was genau im Beitrag aus Deiner Sicht missverständlich beschrieben wird. Eine Klarstellung, wie es Stefan formuliert, kann ich in Deinen beiden Kommentaren jedenfalls nicht erkennen.

Die betreffenden Motive werden sowohl von der Berliner Zeitung, wie auch von Dir persönlich (z.B. auf Instagram), vielfach verwendet, ohne dass ersichtlich wäre, dass das jeweilige Motive nicht einen realen Menschen abbildet. Dort, wo explizit auf die Idee zur Kampagne eingegangen wird, etwa in diesem BZ-Beitrag, wird zwar in Textform und auch im Detail auf den KI-Ursprung eingegangen. An den entscheidenden Stellen allerdings, dort, wo es darum geht Aufmerksamkeit zu erzeugen, und dort wo die Motive im Netz eine breite Verwendung finden, fehlt vielfach der Hinweis auf den KI-Ursprung.

Das Beispiel des Covers habe ich im Beitrag erwähnt. Hier fehlt ein KI-Hinweis. An dieser Aussage ist eigentlich nichts missverständlich.

Es gibt viele weitere Anwendungsfälle, bei denen der Hinweis fehlt. So zum Beispiel auf dem BZ-Facebook-Account:

Gleiches auf Instagram – kein Hinweis dazu, dass das Motiv KI-generiert ist. Es gibt auch keinen inhaltlichen Bezug zum Thema Künstliche Intelligenz, lediglich ein Konjunktiv („wie würde…), das kaum als Erklärung angesehen werden kann, sowie eine unzureichende respektive falsche Bildunterschrift – hier heißt es lediglich „Bärbel Bohley“.

Auch über Deine eigenen Kanäle, Raban, finden die Kampagnenmotive Verbreitung. Und nicht immer enthält der Beitrag einen Hinweis auf den KI-Ursprung, so wie hier:

Es ist schon richtig: einen erklärenden redaktionellen Text zu dem Thema, den gibt es. An vielen Stellen finden sich auch Bildunterschriften, wenn auch teilweise zu klein (siehe Anmerkung von moritz).

Die Art und Weise, wie die Motive von verantwortlicher Seite eingesetzt und verbreitet werden, lässt allerdings erkennen, dass hierbei Risiken, Gefahren und Auswirkungen, wenn auch nicht missachtet, so aber doch übersehen werden. Auf der einen Seite steht ein einzelner erklärender redaktioneller Beitrag, bzw. mit dem dt-Beitrag sind es zwei. Dem gegenüber stehen tausendfach, schon bald millionenfach unkommentierte Fake-Bilder, die erscheinen, wenn User die Namen der genannten Personen in Suchmaschinen eintippen.

Wenn ich mit Midjourney arbeite (nebenbei gesagt tue ich dies schon länger als ein Jahr) und mir auf Discord die Ergebnisse Anderer anschaue, quasi in einem geschlossenen Raum, dann weiß ich: die gezeigten Personen sind nicht real. Wenn User/Anwender hingegen im Netz nach „Mahatma Gandhi“ suchen und dann mit Fake-Bildern wie der BZ-Kampagne konfrontiert sind, diese womöglich für bare Münze nehmen, stellt dies eine Gefahr dar. Für uns Kreativschaffende, Designer, Illustratoren, Grafiker, wie auch für alle anderen „Medienhersteller“ ergibt sich daraus eine besondere Verantwortung.

Weshalb nicht? Wenn Du Deine Auffassung konkretisieren könntest, wäre das fein. Die Personen werden in meinen Augen instrumentalisiert und vor den Karren der BZ gespannt, ohne, dass sie gefragt worden wären. Der jeweilige Mensch wird übergangen. Ob tot oder nicht, macht für mich dabei eigentlich keinen Unterschied.

Danke für den Austausch.

Zur Kenntlichmachung:

Eigentlich führen alle Links zur beschreibenden Geshichte. Da wo das nicht der Fall sein sollte, werde ich mich dafür einsetzen, dass das nachgeholt wird. Noch einmal: Redaktion und ich wollen unbedingt, dass das als mit KI entstanden wahrgenommen wird. So steht es deshalb auch in den Veröffentlichungen auf gosee, slanted und designmadeingermany.

Zur Kampagne:

Die Rubrik OPEN SOURCE ist ein Angebot der Berliner Zeitung zur Demokratisierung der Medienlandschaft. Ein Konzept, das seit zwei Jahren sehr erfolgreich funktioniert. OPEN SOURCE wurde als Name gewählt, um den offenen Zugang für jede:n zu verdeutlichen.

Die Kampagne startete zum 34. Jahrestag des Mauerfalls und spannt einen Bogen von freiem Denken über freie Rede zum freien Menschen. Personen der Zeitgeschichte werden ständig zu Kommunikationszwecken verwendet, wie Achim in seinem Eingangsartikel richtig beschrieben hat.

Wir haben diese Personen mit Hochachtung ausgewählt, weil z.B ich als in der DDR geborener, durch die friedliche Revolution maßgeblich geprägter Gestalter diese Menschen als Vorbilder sehe. Sie haben sich für Gerechtigkeit engargiert und immer wieder für das Reden und gegen die Gewalt. Das mag polemisch klingen, aber mir ist es ernst:

Ohne eine Wiederentdeckung des vorwurfsfreien Gespräches und einer wirklich offenen und gewaltfreien Kommunikation, werden wir die Demokratie weiter schwächen und dann bekommen wir ganz andere Probleme, als alle KI-Bilder zusammen auslösen können. Ich habe, um auf dieses Drama hinzuweisen, die KI verwendet, um eine Idee umzusetzen. Ohne diese Technik wäre es vielleicht eine Collage geworden oder ein Rendering.

Und hier beginnt die Debatte über KI und sie ist so komplex, dass ich dem nicht in wenigen Sätzen gerecht werden kann. LG Rbn

Achim,

hast du vor dem Erstellen und Veröffentlichen des Blogeintrags zuvor mit den Verantwortlichen der Berliner Zeitung gesprochen, das Problem beschrieben und um eine Stellungnahme gebeten?

Nein. Natürlich gibt es viele Fälle, bei denen ich vor Veröffentlichung eines Beitrags die verantwortliche Stelle um ein Statement bitte. Typisch sind hier etwa Redesigns. Aber dies geschieht stets situativ. Beispielsweise gebe ich auch einer ausschreibenden Stelle (Unternehmen, Verein, öffentliche Hand, u.a.) die Möglichkeit, zu den von anderen dt-Lesern erhobenen und an mich herangetragenen Vorwürfen, Stellung zu nehmen. Vielfach bleiben diese Mails, wie etwa im Fall der unfairen Ausschreibung der Stiftung für Hochschulzulassung (SfH), unbeantwortet. Manchmal erhalte ich eine Antwort, und kann diese dann berücksichtigen. In wenigen Fällen konnte im Zuge eines Vorabaustauschs erreicht werden, dass Teilnahmebedingungen verbessert werden konnten, etwa weil auf die darin enthaltene Abtretung der Verwendungsrechte an den Entwürfen ALLER Teilnehmer verzichtet wurde. In der Vergangenheit wurde von mir beispielsweise auch Kritik in Form eines offenen Schreibens formuliert, um so die Fragen an die verantwortliche Stelle heranzutragen. In bestimmten Fällen, so auch in diesem Fall, schreibe ich die Verantwortlichen bewusst nicht an, da ich es wichtig finde, den IST-Zustand zu dokumentieren, um so dt-Lesern die Möglichkeit zu geben, hierzu ihre Meinung kundzutun. Auch meine Kritik knüpft sich an den IST-Zustand an. In diesem Fall hatte ich zudem darauf gebaut/vertraut, dass das Thema zeitnah die Redaktion erreicht.

Wenn sich hier mit den Verantwortlichen auf Seiten der BZ ein weiterer Austausch ergäbe, insbesondere auch von Seiten der Redaktion, würde mich das freuen.

Hm. Schade, dass sie noch nicht geantwortet haben. Aber kommt vielleicht noch.

Die Hauptverantwortlichkeit für den Umgang mit diesen Dingen liegt m. E. doch nicht nicht beim Konzepter/Illustrator (Ruddigkeit, der sich freundlicherweise gemeldet hat).

Außer: Er ist dazu der Redakteur.

Scheint jedoch nicht so.

Werbung versucht immer wieder zu provozieren. Erstellt Tag für Tag Phantasiebilder. Also warum nicht auch solche. Die Realität dürfen andere abbilden. Vielleicht ist hier auch der Wiederspruch zu finden. Auf der einen Seite die Werbung, die solchen Kampagnen definitiv “darf”. Und auf der anderen Seite die Berliner Zeitung, die uns doch bitte von der Realität berichten soll und solche gefakten Bilder eigentlich “nicht darf”.

Ich persönlich finde die Werbekampagne nicht sonderlich gelungen. Das eingesetzte Konzept ist nicht neu, sondern asbach uralt. Manch ein Abgebildeter sieht aus, als hätte er Zahnschmerzen. Auch erschließt sich mir die Botschaft erst, nachdem ich deinen Artikel dazu gelesen habe. Aber vielleicht gibt es auch noch Anzeigen mit Headlines, in denen die Botschaft verständlich rüber kommt.

Über den Einsatz von KI möchte ich sagen, das gerade die Werbung die Pflicht hat so viel es geht auszuprobieren. Denn erst durch Fehler lernt man. Bereits jetzt alle möglichen Regeln aufzustellen halte ich für kontra produktiv. Die KI als Werkzeug hat sich ja gerade erst der Welt gezeigt. Angst vor Ihr brauchen wir nicht zu haben.

Die Pflicht?

Werbung ist ein Spiegel der Gesellschaft, bedient sich aus Facetten von ihr, um Aufmerksamkeit zu bekommen. Aber die Pflicht, Grenzen zu überschreiten? Ernsthaft?

Disclosure:

War früher ein kleiner ehrgeiziger Werbefritze mit kleinem Team in einer großen Agentur. Jung v. matt war eine Zeitlang meine große Ikone. Das Ding mit dem Trojaner war richtig frech, fühlte sich an wie eine Grenzüberschreitung von Topkreativen. Das hier jedoch ist eine andere Nummer. Vielleicht kann eine Agentur damit Grenzüberschreitung betreiben. Kann. Doch einzahlen auf das Konto des Produkts oder auf das Konto des Images des Werbekunden …? Kaum. Die Zeiten sind anders: Unternehmen stehen verstärkt in der Kritik. Und zwar mit Allem. Umwelt, Natur, Zerstörung, Datenschutz, KI, Fakes. Wenn es wirklich total toll wäre, Bilder, die mit KI generiert aber nicht gekennzeichnet sind, hätte J.v.M. oder eine anderes Werbeunternehmen das längst gemacht und sich offen als alte out-of-the-box-ler mit dieser Frechheit gebrüstet.

Also nicht toll.

Sehr schön in der heutigen Zeit etwas zu lesen, in dem es noch um Moral und Ethik geht!

Ansonsten hat man eher das Gefühl, das sind überholte Begriffe – Klicks und Likes sind stattdessen das Einzige, was das Verhalten bestimmt und entscheidet, was richtig oder falsch, gut oder schlecht ist.

Völlig zurecht ist das eine widerliche Kampagne. Und überraschend enttäuschend, dass sie von einer eigentlich eher seriösen Institution kommt und nicht aus dem Schmuddelmileau.

Zum Thema: Ich drehe den Spieß mal um: Was, wenn in Zukunft KI-generierte Bilder so omnipräsent und selbstverständlich werden, dass uns Fotos der Realität nicht mehr erreichen? Was, wenn der Verstand in Zukunft durch KI eine derartige Abstumpfung erfahren hat, dass Bilder keine Reaktion oder Wirkung mehr erzeugen? Oder anders formuliert: Wenn man in Zukunft bewusst drunter schreiben muss: “Lasst es an euch heran, dieses Foto ist echt!” Ich denke da insbesondere an Reporterarbeiten, die menschliche Krisen oder dramatische Umweltentwicklungen mit Bildermotiven kommunizieren wollen. Können Bilder als informatives Medium überhaupt noch funktionieren?

Gab es nicht auch mal eine provokante Dacia-Werbung mit Che, Lenin, Marx, Castro und anderen ‘Revoluzern und Kapitalismuskritikern’, die somit unpassend in einer Autowerbung vorkamen..? Erinnert mich etwas daran.

Sehe ich ganz genauso, sonderlich kreativ ist die Kampagne zudem auch nicht.

In den Anfangszeiten von Photoshop kam ja schon ähnliches zustande. Jetzt ist es aber so das wirklich jeder so etwas generieren lassen kann. Völlig unabhängig von Kontext und Wissen.

Insofern wird es immer mehr um Glaubwürdigkeit gehen.

Jedenfalls stellt sich mir jetzt schon die Frage, welche Werte der Verlag bzw. die Zeitung hat. Glaubwürdig finde ich das alles nicht.

Zu “Jedenfalls stellt sich mir j e t z t s c h o n die Frage, welche Werte der Verlag bzw. die Zeitung hat. Glaubwürdig finde ich das alles nicht.”:

Einerseits stimme ich hier, was die Glaubwürdigkeit der Kampagne angeht, zu. Allerdings stellte sich (für mich) die Frage nach den Werten des Verlags, der Zeitung doch bereits vor KI generierten Bildern bzw. bei allen anderen (auch vorherigen oder folgenden) Kampagnen. Schon als Erstleser hätte sich (aus meiner Sicht) die Frage sofort beantwortet: Größtenteils harmlos!

den beschriebenen großen respekt für personen der zeitgeschichte und

ihren kampf um frieden und freiheit kann ich pers. kaum nachvollziehen.

tatsächlich freigegebene presse-fotos, die derart intime und verletzliche

momentaufnahmen zeigen, gibt es wohl von keinem der abgebildeten.

solange die erben dies nicht ausdrücklich und noch dazu in einem werb-

lichen kontext (der mit nichten gemeinnützig ist) genehmigt haben –

scheint mir die anwendung von ki in diesem fall unlauter und in ihrer

veröffentlichung, die die büchse der pandora weit aufbricht, unvertretbar.

Naja gerade wenn die Person tot ist sehe ich da kein wirkliches Problem. Viele schreien da halt aus Prinzip rum, “weil KI”. Dabei hätte man dieselben Motive auch per Hand oder digital photorealistisch zeichnen können. Hätte dann sicherlich keinen Aufschrei gegeben, weil ja keine KI involviert war…

Theoretisch schon, praktisch auch. Aber erkennst Du nicht die Problematik? Der dahinter stehende Aufwand ist derart groß, dass kein Auftraggeber bereit ist, schon gar nicht die Redaktion einer Tageszeitung, das damit verbundene hohe Honorar zu bezahlen. Vergleichbare Werke von Menschenhand zu erschaffen würde mehrere Wochen dauern. In der schnelllebigen Nachrichtenbranche können sich Redaktionen auch das – Zeit – nicht bzw. nur noch selten leisten. Die Aussage „hätte man auch per Hand …“ ist also ein reines Scheinargument. Als solches kann es den Einsatz von KI nicht relativieren, denn andere zur Verfügung stehende Möglichkeiten werden aus den oben genannten Gründen gar nicht genutzt! Nicht in diesem Kontext (Werbung, Kommerz, Journalismus). Erst mit KI wird das Unmögliche, Undenkbare, Unwirtschaftliche möglich.

Also wäre es okay gewesen wenn sie jemanden engagiert hätten, ihm ein hohes Honorar gezahlt hätten und er oder sie wochenlang damit beschäftigt wäre?

Dein Problem ist es das es zu schnell geht? Ernsthaft?

In meinem vorhergehenden Kommentar habe ich zum Ausdruck gebracht, dass die Aussage, „hätte man auch per Hand erstellen können“, meiner Ansicht nach ein Scheinargument darstellt. Denn der Aufwand, zeitlich wie finanziell, ist zu hoch, als dass die Erstellung entsprechender Werke von Menschenhand in diesem Fall eine Option gewesen wäre.

Ahoi Achim, ich bin zwar auch der Ansicht, dass eine Umsetzung als Illustration mit offensichtlich illustrativen Mitteln einen deutlichen Unterschied machen würde, meine aber, dass das Kriterium Zeit und Geld in die falsche Richtung führt.

Vielmehr sollte die Diskussion sich um das Thema DeepFake drehen, also darum, in wie weit hier (zumindest ohne Kennzeichnung) jemand ohne entsprechende (Branchen- bzw. Technologie-)Kenntnisse dazu gebracht wird, Bildern, die wie Fotografien aussehen, noch zu vertrauen.

Dieses Vertrauen war schon vor KI durch Werkzeuge wie Photoshop nur noch bedingt gegeben. Und ich empfinde den Vertrauensverlust einer Berichterstattung in unserer Bilder-lastigen Welt (ja gerade in der Presse – zu der ich den Auftraggeber zähle – , viel mehr als in der Werbung) als dramatisch.

Ich kann mir, wie hier ja bereits gepostet wurde, gut vorstellen, dass eine deutlich illustrativere Lösung nicht dieselbe Aufmerksamkeit erreicht hätte. Das würde uns aber eher zur ethischen Diskussion führen, ob der Aufmerksamkeit alles unterzuordnen ist.

Ich glaube man muss da schon differenzieren: die frage der hinter der Umsetzung liegenden Technologie lässt sich gut sehr losgelöst vom Kampagnenkonzept diskutieren. Wäre der Einsatz dieser prominenten Personen immer noch „kein Problem“ wenn diese nicht für eine Zeitung, sondern für ein Energieunternehmen werben würden? Oder eine Fast-Food-Kette? Für eine politische Partei? Gar für die AfD? Und wenn, warum nicht? Wo wäre der Unterschied, wenn Werbung „alles darf“? Wenn es egal ist, dass hier echte Menschen, deren Vermächtnis und deren Erben/Angehörige/Freunde betroffen sind?

Ahoi Jürgen,

Du hast recht, man kann hier auch über das Kampagenkonzept diskutieren. Wie bereits gepostet wurde, haben solche Konzepte in der Vergangegnheit schon Gerichte beschäftigt, es gibt also in Deutschland eine Rechtsprechung dazu. Wie auch immer man dazu steht.

Achim bezog sich aber mit seinem Artikel besonders auf den technischen Aspekt. Meiner Meinung nach ist dieser aktuell dringlicher, da es in der vorliegenden Kampagne eben nicht um den Einsatz vorhandener Bilder in einem anderen (hier: werblichen) Kontext geht, sondern um den Einsatz von Illustrationen als (vorgeblich) möglichst echten Darstellungen von Personen geht, denen durch die Technik eine bestimmte Bildaussage angedichtet wird. Auch wenn wir hier vieleicht noch von „unechten Emotionen“ sprechen, ist der Schritt zur „Falschaussage“ so kurz wie fließend.

Und da die Technik mittlerweile (ich spreche hier absichtlich nicht von KI, denn auch die Retuschemöglichkeiten mit Photoshop sind weit genug fortgeschritten) in der Lage ist, Fälschungen zu erzeugen, die sowohl den ungeübten, als auch den geübten Betrachter täuschen, finde ich es an der Zeit, die Diskussion um deutliche Kennzeichnung solcher Bilder intensiver denn jeh zu führen.

Gerade das Beispiel der Internetsuche, die diese Bilder irgendwann ungekennzeichnet als „Realität“ zurückspielt (und eventuell in die nächste KI Generation einfliesst), finde ich erschreckend. Und da kann mich auch Rabans Kommentar, dass alle Fundstücke auf den Artikel zeigen, nicht beruhigen. Spätenstens wenn sich die Bilder in Sammlungen wie Pinterest wiederfinden, gehen solche Links verloren und die Bilder stehen für sich. Die Generation der jetzigen Schüler und mit Sicherheit um so mehr die ihr folgende zieht sich diese Bilder dann für ihre Referate.

Die Macht der Bilder ist real. Ihre Inhalte sind es nicht mehr.

Hat nicht ein gemaltes Bild, eine Fotografie (so sprachen meist Maler und Fotografen) einen Inhalt der nur annähernd die Realität beschreibt? Wenn nun Inhalte der KI als “nicht mehr real” bezeichnet werden (müssten), sind sie dann was? Virtuel, Fake oder gar Kunst? Für mich bleibt schon jenseits der KI jeder analoge “Fake” schwierig aufklärbar. Beispielsweise ein Mensch in Uniform: hat reale Macht – wie aber wäre sein Inhalt, seine “Echtheit” auf den ersten Blick und absolut verizifierbar? Am Ende müssen wir lernen zu vertrauen. Der Produktkennzeichnung, dem Verlagshaus oder uns selbst. Dabei hilft aus meiner Sicht und auch in Zukunft: der Zweifel.

Danke für Deine beiden Kommentare Ray Nher. So ist es. Die Verlinkung geht verloren, der Mechanik des Internets folgend. Schon haben auch erste Content-Aggregatoren (Beispiel „we love news“) die Bilder erfasst und verwenden diese auf ihren Websites ohne dass eine Verlinkung zum Ursprung erfolgen würde. Dort stehen die Bilder nur für sich, bzw. werden diese in einen falschen Kontext gestellt.